D’ici la fin 2026, le volume mondial de données devrait avoisiner les 230 zettaoctets : un chiffre si vertigineux qu’il en devient presque abstrait. Pourtant, derrière ces chiffres, une question très concrète se pose à chaque organisation : comment stocker, organiser et exploiter cette masse d’informations sans se noyer dedans ? C’est précisément là qu’intervient les Data Lakes. Ni entrepôt classique, ni simple serveur de fichiers, le lac de données est une infrastructure pensée pour centraliser tout type de données, brutes, hétérogènes, volumineuses, et les rendre exploitables quand le besoin s’en fait sentir. Tour d’horizon de ce que vous devez savoir.

Source : Journal du net

Définition & Origines

Qu’est-ce qu’un Data Lake ?

Imaginez un immense réservoir dans lequel se déversent, sans tri ni filtrage, des torrents de données venues de partout : capteurs industriels, fichiers RH, logs applicatifs, images, vidéos, e-mails… C’est exactement l’image que renvoie le terme « Data Lake » : le lac de données. Une métaphore efficace pour décrire une infrastructure qui a profondément reconfiguré la gestion du patrimoine informationnel des entreprises.

Techniquement, un Data Lake est un référentiel centralisé conçu pour accueillir des volumes massifs de données dans leur format d’origine, sans transformation préalable. On stocke d’abord, on structure ensuite, selon les besoins. C’est ce qu’on appelle le schema-on-read, une logique qui confère au lac une souplesse que peu d’architectures peuvent égaler.

Le concept a été formalisé en 2010 par James Dixon, alors directeur technique de Pentaho, pour répondre à une question simple mais épineuse : comment stocker des données hétérogènes sans savoir encore à quoi elles serviront ? À l’époque, le Big Data commençait à bousculer les certitudes des DSI, et les entrepôts traditionnels montraient déjà leurs limites.

Aujourd’hui, le Data Lake est devenu un outil de référence pour les équipes data science et les projets d’IA. Entraîner des modèles de machine learning, détecter des anomalies, construire des recommandations personnalisées : toutes ces opérations nécessitent des volumes de données brutes que seul un lac peut fournir dans les conditions requises : accessible à tous les collaborateurs, quel que soit leur service ou leur localisation.

Vous voulez savoir si un Data Lake est la bonne infrastructure pour votre stratégie data ?

Fonctionnement Technique

Architecture & Stockage

Oubliez les hiérarchies de dossiers et les arborescences bien rangées : un Data Lake fonctionne sur une architecture dite « plate », non hiérarchique. Chaque donnée ingérée reçoit un identifiant unique associé à des métadonnées descriptives : origine, date, format, type de contenu, ce qui permet de retrouver une information précise dans des volumes colossaux sans organisation physique rigide.

Le lac accepte tous les formats sans exception : CSV, JSON, XML, PDF, images, vidéos, flux IoT, enregistrements audio… Tout est ingéré tel quel, sans conversion préalable, ce qui en fait un outil particulièrement adapté aux organisations dont les systèmes d’information sont hétérogènes.

🎯Bon à savoir

L’un des pièges fréquents lors de la mise en place d’un Data Lake est de négliger la gestion des métadonnées. Sans un catalogage rigoureux dès l’ingestion, retrouver une donnée spécifique dans un lac contenant des pétaoctets d’informations peut rapidement devenir un exercice fastidieux, voire impossible. Sans gouvernance adaptée, les entreprises risquent de ne disposer que d’un Data Swamp, un véritable bourbier de données impraticables : la gestion des métadonnées n’est pas une option, c’est le socle sur lequel repose toute l’exploitabilité du lac. Source : LeMagIT

Architecturalement, le lac s’organise en quatre couches successives : la zone d’ingestion (collecte des données sources), la zone de stockage brut (conservation dans l’état natif), une couche de standardisation optionnelle, et enfin la couche nettoyée, ou curated layer, où les données sont prêtes à être consommées par les outils analytiques et les modèles de machine learning.

Modes de traitement des données

Stocker des données, c’est bien. Savoir les traiter efficacement, c’est là que tout se joue. Un Data Lake n’est pas un simple entrepôt passif, c’est une infrastructure pensée pour que les données qu’il contient puissent être activées, transformées et analysées de multiples façons, selon des temporalités et des objectifs très différents. Et c’est précisément cette polyvalence de traitement qui en fait un outil aussi central dans les stratégies data des grandes organisations.

Deux modes de traitement coexistent au sein d’un lac de données, et ils répondent à des besoins bien distincts.

Le premier est le batch processing, ou traitement par lots. Il s’agit de collecter de grandes quantités de données sur une période donnée, puis de les traiter en une seule opération différée. Cette approche convient parfaitement aux cas où la latence n’est pas un facteur critique : consolidation de rapports financiers mensuels, retraitement de données historiques, calcul de scores de risque sur l’ensemble d’un portefeuille clients… Le batch processing privilégie le volume et l’exhaustivité sur la réactivité.

Le second mode est le stream processing, ou traitement en flux. Ici, les données sont traitées en temps réel, au fil de leur arrivée, par petits lots successifs. C’est cette approche qui alimente les systèmes de détection de fraude bancaire, les tableaux de bord opérationnels mis à jour à la seconde, ou encore les moteurs de recommandation qui s’ajustent en continu au comportement des utilisateurs. Dans un contexte où la vitesse de réaction devient un avantage concurrentiel, le stream processing est de plus en plus valorisé par les entreprises.

👉 Remarque

Batch et stream processing ne sont pas mutuellement exclusifs. La majorité des architectures Data Lake modernes les combinent intelligemment : le traitement en flux pour les données à forte valeur temps, le traitement par lots pour les analyses de fond et les consolidations périodiques. Cette complémentarité est au cœur des architectures dites Lambda ou Kappa, deux patterns architecturaux de référence dans l’écosystème data. Source : Talend

Une fois les données ingérées et traitées, elles peuvent faire l’objet de quatre grandes familles d’analyse, chacune répondant à une question métier précise :

L’analyse descriptive répond à la question « que s’est-il passé ? », elle dresse un état des lieux objectif à partir des données historiques. L’analyse diagnostique va un cran plus loin en cherchant à comprendre « pourquoi cela s’est-il produit ? », elle fouille les corrélations et les causes sous-jacentes d’un phénomène observé. L’analyse prédictive, nourrie par des algorithmes de machine learning, tente de répondre à « que va-t-il se passer ? » elle modélise des comportements futurs probables à partir de patterns identifiés dans les données passées. Enfin, l’analyse prescriptive franchit une étape supplémentaire en suggérant « que doit-on faire ? », elle produit des recommandations d’action directement actionnables par les équipes métiers.

Pour exploiter concrètement ces analyses, les data engineers et data scientists s’appuient sur plusieurs langages et outils selon la nature du traitement à effectuer. SQL reste incontournable pour interroger des données structurées et produire des rapports. Python s’impose comme le langage de référence pour le machine learning et la manipulation de données complexes. Spark, de son côté, est particulièrement adapté au traitement distribué de volumes massifs, avec une capacité à paralléliser les calculs sur des clusters de serveurs.

Ce qui rend le Data Lake particulièrement précieux dans ce contexte, c’est qu’il n’impose aucune contrainte sur l’usage futur des données au moment de leur stockage. Une organisation peut ingérer aujourd’hui des données dont elle ne sait pas encore exactement comment elle les exploitera dans six mois. Lorsque le besoin se précise, elle transforme et structure ces données en conséquence. Cette logique de « stocker maintenant, décider ensuite » est une rupture majeure par rapport aux approches traditionnelles.

👉 Remarque

D’après Gartner, d’ici 2025, plus de 85 % des stratégies data des grandes entreprises reposeront sur une architecture combinant Data Lake et capacités analytiques avancées pour alimenter leurs modèles d’IA. Source : Gartner

C’est d’ailleurs sur ce point que le Data Lake s’affirme comme un fondement indispensable des projets d’intelligence artificielle. Entraîner un modèle de deep learning exige des volumes de données brutes considérables, dans des formats variés, souvent non structurés. Aucune autre infrastructure ne permet d’alimenter ce type de pipeline avec autant de souplesse et à cette échelle. Le lac de données n’est pas qu’un outil de stockage, c’est le carburant des systèmes intelligents de demain.

Vous voulez structurer votre architecture data et tirer parti de vos données ?

Avantages

Flexibilité, Scalabilité & Valeur Métier

Si le Data Lake s’est imposé aussi rapidement dans les organisations, ce n’est pas par effet de mode. C’est parce qu’il répond à des problèmes concrets que les architectures traditionnelles ne parvenaient plus à résoudre face à l’explosion des volumes et à la diversité des données. Voici les raisons qui en font un choix stratégique.

Sa première force, c’est sa flexibilité : données structurées d’un ERP, fichiers JSON d’une API, images, transcriptions audio : tout entre dans le lac tel quel, sans conversion préalable. Une liberté qui n’est pas un luxe, mais une nécessité opérationnelle pour les équipes data aux prises avec des sources toujours plus hétérogènes.

L’évolutivité suit naturellement : reposant sur une architecture distribuée, le lac s’adapte sans rupture à la croissance des volumes, jusqu’à plusieurs pétaoctets. La centralisation brise quant à elle les silos entre CRM, ERP et outils métiers, offrant un point de convergence unique accessible à toutes les équipes. Enfin, le Data Lake constitue une archive historique fidèle : les données brutes y sont conservées sans altération, ce qui permet des analyses rétrospectives et répond aux exigences réglementaires des secteurs les plus encadrés.

Data Lake vs Data Warehouse & Évolutions

Différences Clés

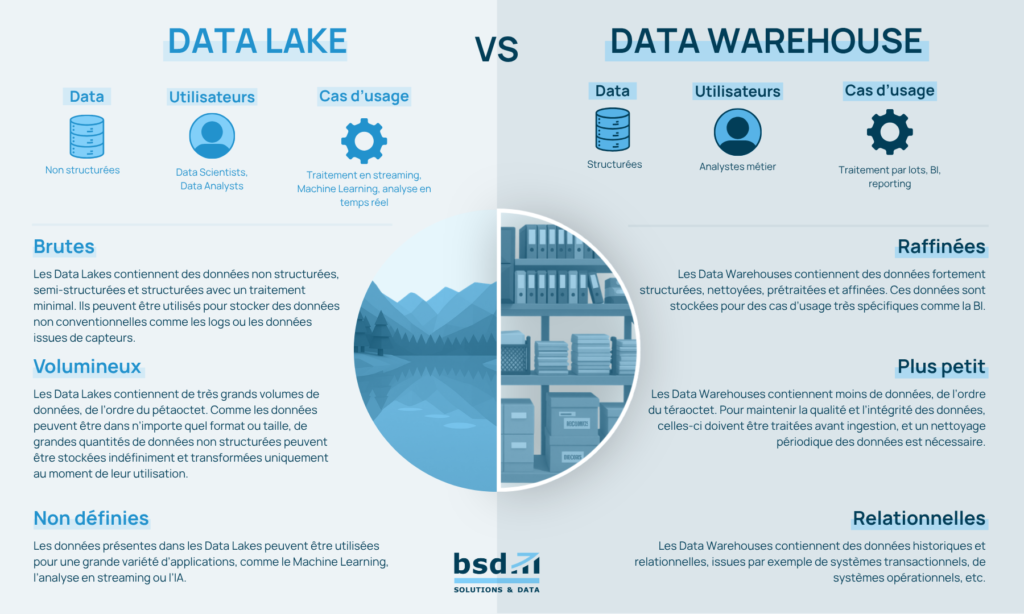

Data Lake et Data Warehouse sont souvent confondus, alors qu’ils répondent à des logiques opposées. Le Data Warehouse fonctionne en schema-on-write : chaque donnée est nettoyée et mise en conformité avec un schéma prédéfini avant d’être chargée. Résultat, une qualité irréprochable pour les rapports BI et les tableaux de bord financiers, mais un processus de préparation long et coûteux.

Le Data Lake inverse cette logique. Les données arrivent brutes, dans leur format natif, et ne sont structurées qu’au moment de leur exploitation (schema-on-read). Pas besoin de savoir à l’avance comment elles seront utilisées, elles sont stockées d’abord, traitées ensuite, selon les besoins.

Les profils d’utilisateurs diffèrent tout autant : le Data Warehouse s’adresse aux équipes BI et aux analystes métiers qui consomment des données déjà préparées, tandis que le Data Lake est le terrain des data scientists et data engineers qui explorent, modélisent et testent sur des données brutes.

Nouvelles Architectures & Déploiement

La vraie question n’est plus « Data Lake ou Data Warehouse ? » mais « comment les faire travailler ensemble ? » C’est de cette réflexion qu’est né le Data Lakehouse : une architecture hybride qui combine la flexibilité de stockage du lac et la performance des requêtes structurées de l’entrepôt. Des plateformes comme Databricks ou Snowflake ont largement popularisé ce modèle, qui s’impose comme la nouvelle référence pour les organisations data-driven.

Sur le plan du déploiement, trois options coexistent. Le on-premise offre un contrôle total mais exige des investissements lourds : il reste pertinent dans les secteurs très réglementés. Le cloud est aujourd’hui le choix dominant : Microsoft Azure, AWS et Google Cloud permettent de déployer un Data Lake opérationnel en quelques heures, avec un modèle à l’usage et une scalabilité quasi illimitée. Entre les deux, les architectures hybrides et multi-cloud gagnent du terrain pour combiner souveraineté des données sensibles et puissance de calcul cloud.

En 2026, le Data Lake franchit une nouvelle étape : celle de l’IA agentique industrielle. Les agents autonomes ne se contentent plus de lire des tableaux de bord, ils interrogent, interprètent et agissent sur la donnée en temps réel. Pour fonctionner de manière fiable, ils ont besoin d’une infrastructure data solide, gouvernée et disponible en continu. Le Data Lake bien architecturé est ce socle. Pourtant, moins de la moitié des entreprises estiment leurs données suffisamment matures pour l’IA agentique ,un signal que la modernisation des infrastructures est désormais une priorité stratégique, pas un chantier pour demain.

Échangez avec notre équipe et bénéficiez d’un accompagnement

Alexis Bourdeau

Directeur de projet