Vos données sont partout et c’est justement le problème. ERP, CRM, outils SaaS, capteurs IoT, fichiers Excel qui traînent depuis 2019… Vos données sont là, dans chaque outil, chaque fichier, chaque système. ERP, CRM, SaaS, IoT, Excel… L’information existe, mais elle reste fragmentée, dispersée, difficile à lire dans sa globalité. Résultat : vos équipes perdent un temps fou à réconcilier des chiffres qui ne se recoupent jamais vraiment, et vos décisions stratégiques reposent sur des bases plus fragiles qu’il n’y paraît. C’est précisément le problème que règle une data platform. Dans cet article, vous découvrirez ce qu’est la data platform, comment ça fonctionne, et surtout comment choisir la solution qui correspond réellement à vos besoins.

Qu’est-ce qu’une Data Platform ?

Définition et rôle fondamental

Une data platform est une infrastructure technologique unifiée dont la mission tient en une phrase : transformer des données brutes, éparpillées aux quatre coins du système d’information, en informations exploitables par l’ensemble des équipes.

Pour bien visualiser son utilité, prenons l’exemple d’une entreprise de taille intermédiaire. Dans celle-ci :

- Les données de facturation sont gérées par l’ERP

- Les données clients sont stockées dans le CRM

- Les métriques de production sont remontées par les capteurs d’atelier

Ici, plusieurs types de données sont mesurées, mais elles n’interagissent pas entre elles et ne sont pas centralisées.

La data platform règle ce problème structurellement : elle centralise la collecte, orchestre le stockage, pilote le traitement et met à disposition des données cohérentes et fiables.

Ce qui la distingue d’un simple outil d’intégration, c’est son périmètre. Une plateforme d’intégration assure la circulation des informations entre systèmes, point. La data platform fait cela, mais elle stocke, analyse, gouverne et alimente les algorithmes d’IA. C’est une couche transversale du système d’information, pas un maillon isolé.

Elle fonctionne comme un centre de gravité vers lequel toutes les données (qu’elles soient structurées, semi structurées ou non structurées) convergent dans une langue commune.

Cela permet, par exemple, à un responsable commercial, un analyste financier et un data scientist de travailler à partir du même référentiel. Le gain de fiabilité est alors immédiat, et les décisions plus rapides et moins sujettes à caution.

Vos données sont dispersées entre plusieurs systèmes et vous peinez à en tirer une vision cohérente ?

Les principaux types de plateformes de données

Toutes les data platforms ne répondent pas aux mêmes besoins. Selon votre contexte et votre maturité data, quatre grandes familles se distinguent.

| Type | Rôle principal | Avantages clés | Exemples concrets | |

|---|---|---|---|---|

| Enterprise Data Platform (EDP) | Centraliser les données métiers à l’échelle de l’organisation | Vision unifiée, casse les silos, gestion de gros volumes | Reporting groupe, consolidation financière, gouvernance data | |

| Big Data Platform (BDP) | Traiter des volumes massifs et des flux en temps réel | Architecture distribuée, haute performance, temps réel | Détection de fraude, maintenance prédictive, streaming | |

| Cloud Data Platform | Déployer et gérer la donnée dans le cloud | Scalabilité, facturation à l’usage, mise en œuvre rapide | Migration cloud, projets agiles, réduction des coûts infra | |

| Customer Data Platform (CDP) | Unifier et activer les données clients | Vision 360° client, personnalisation, connectivité marketing | Segmentation, campagnes ciblées, expérience client | |

🎯Bon à savoir

Ces approches peuvent tout à fait se combiner si elle cela permet de construire l’architecture la plus adaptée à vos usages spécifiques !

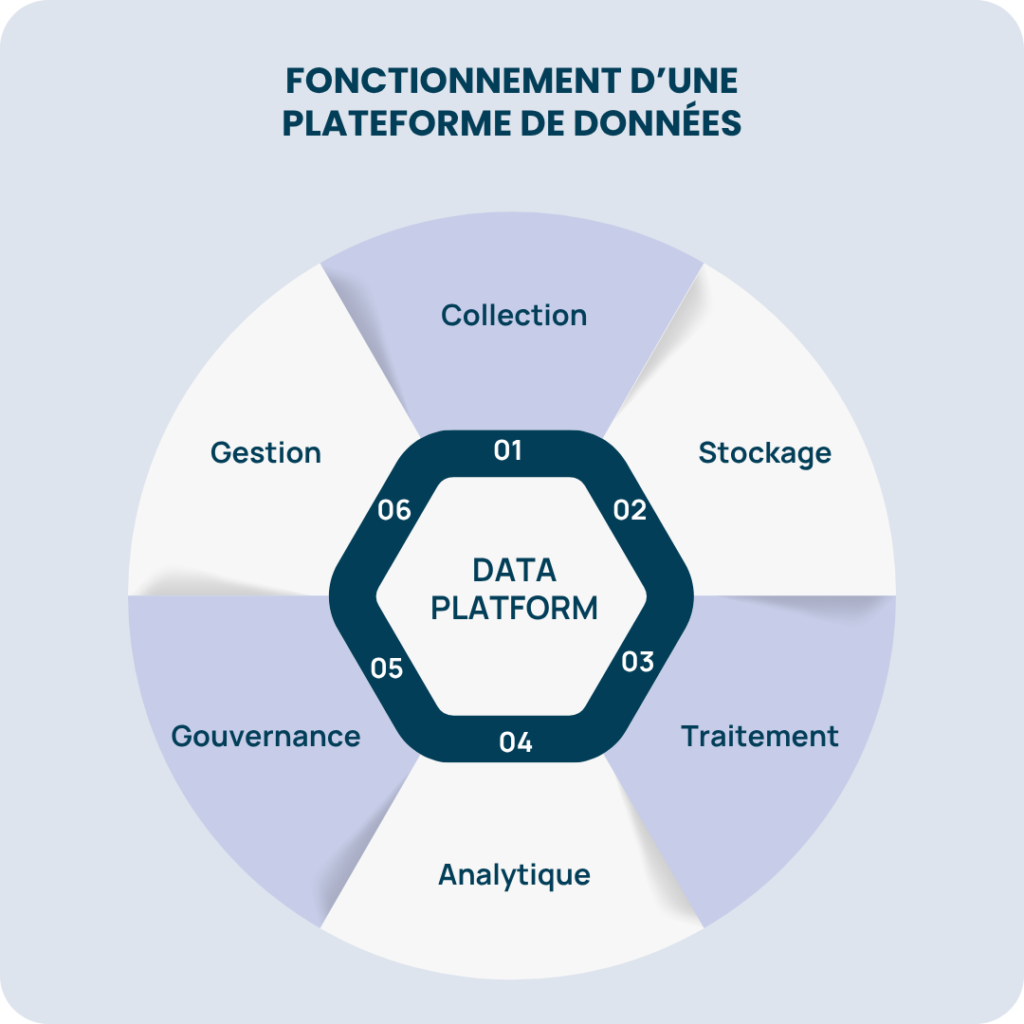

Architecture : les couches fondamentales d’une Data Platform

Une data platform repose sur des couches complémentaires, de la collecte des données brutes jusqu’à leur restitution. Comprendre ces blocs, c’est comprendre comment la donnée circule et devient exploitable.

Collecte, stockage et ingestion des données

L’ingestion et le stockage constituent les deux fondations de la data platform. Ces éléments permettent de collecter correctement les données, et sont donc essentiels dans la chaîne analytique.

L’ingestion désigne le processus par lequel la plateforme collecte les données là où elles se trouvent : ERP, CRM, SaaS, capteurs IoT, API, fichiers CSV… Chaque source a son propre format et son propre rythme.

Deux modes coexistent :

- Le batch traite les données par lots à intervalles définis, économique et suffisant pour un reporting financier nocturne.

- Le streaming traite les données au fil de l’eau, indispensable pour la détection de fraude en temps réel ou le pilotage logistique à la minute.

Note

La plupart des architectures sérieuses combinent les deux modes d’ingestion.

Côté stockage, trois architectures s’imposent :

- Le data warehouse stocke des données structurées pour des requêtes analytiques performantes, Snowflake, BigQuery ou Microsoft Synapse en sont les représentants cloud.

- Le data lake héberge tout dans son format brut, avec une grande flexibilité mais un risque réel de se transformer rapidement en data swamp, ce marécage de données où plus personne ne sait ce qui est fiable, dans le cas où il n’y a pas de grouvernance.

- Le data lakehouse réconcilie les deux en combinant stockage objet à faible coût et performances analytiques, via des formats ouverts comme Delta Lake ou Apache Iceberg. C’est le modèle sur lequel repose Microsoft Fabric avec OneLake.

De la donnée brute à la décision

Une fois les données collectées et stockées, encore faut-il les rendre fiables, lisibles et exploitables. Cette partie couvre trois couches complémentaires : la transformation, qui structure la donnée brute ; l’analyse et la BI, qui la restituent aux métiers ; et l’intelligence, qui permet d’anticiper et d’automatiser.

Transformation

C’est la couche la moins visible du projet, mais celle dont les métiers ressentent immédiatement l’absence quand elle est défaillante. Elle recouvre tout ce qui permet de passer d’une donnée brute à une donnée fiable : nettoyage des doublons, normalisation des formats, enrichissement avec des référentiels externes.

Deux approches s’opposent :

- L’ETL (Extract, Transform, Load) transforme les données avant de les charger. Approche prudente, elle garantit la qualité à l’entrée.

- L’ELT (Extract, Load, Transform) charge d’abord les données brutes, puis les transforme à la demande. Cette méthode est plus rapide, mais exige une gouvernance rigoureuse pour éviter les interprétations divergentes.

En pratique, les deux coexistent souvent au sein d’une même architecture.

Analyse et Business Intelligence

C’est ici que la donnée devient lisible pour les métiers. La Business Intelligence (BI) regroupe les tableaux de bord, KPIs et rapports interactifs produits via des outils comme Power BI, Tableau ou Looker. L’objectif : permettre à un contrôleur de gestion ou un responsable commercial d’explorer ses données en autonomie, sans solliciter la DSI.

Pour que cette couche reste fiable dans le temps, deux dispositifs sont indispensables :

- Le data catalog joue le rôle de référentiel central de la donnée : qui a créé cette table, quand a-t-elle été mise à jour, quelle est sa définition métier ? Sans lui, les équipes passent leur temps à chercher la source d’un chiffre plutôt qu’à l’analyser.

- L’observabilité surveille en continu la santé des pipelines, un fichier source non livré, une colonne soudainement à 30 % de valeurs nulles. L’objectif est de détecter les anomalies avant qu’elles n’atterrissent dans un rapport de direction.

Intelligence prédictive et générative

Au-delà de la restitution, la data platform peut devenir un moteur d’anticipation et d’automatisation grâce à deux régimes complémentaires :

- L’IA prédictive modélise des comportements futurs à partir de données historiques : prédiction du churn, anticipation des ventes, détection d’anomalies industrielles.

- L’IA générative crée du contenu à partir des données disponibles : résumés automatiques, analyses narratives, génération de code SQL en langage naturel.

Ces usages sont déjà en production dans des entreprises de toutes tailles, à condition que la plateforme qui les alimente soit structurée et fiable.

Vous souhaitez savoir quelle architecture data correspond à votre système d’information et à vos cas d’usage prioritaires ?

Ce qui rend une plateforme fiable et pérenne

Collecter, stocker et transformer les données ne suffit pas. Une data platform durable repose aussi sur sa capacité à fiabiliser la donnée dans le temps, à protéger les accès, à s’intégrer dans un écosystème existant et à évoluer sans tout reconstruire. Ces dimensions sont rarement prioritaires en phase de cadrage, elles finissent pourtant par conditionner la réussite du projet.

Gouvernance

Dans une entreprise multi-entités, le mot « client » peut désigner des réalités différentes selon les services. Sans référentiel partagé, les incohérences s’accumulent silencieusement. Un cadre de gouvernance solide passe par la désignation de data owners, des règles de qualité appliquées à chaque ingestion, et un data lineage qui rend chaque transformation auditable de bout en bout.

Sécurité

La sécurité d’une data platform repose sur trois mécanismes complémentaires : le chiffrement des données au repos et en transit, la gestion des identités et des accès par rôles (IAM), et les journaux d’audit qui tracent chaque consultation, modification ou export. Dans un contexte RGPD, cette traçabilité est une obligation légale dont le non-respect expose l’entreprise à des sanctions pouvant atteindre 4 % du chiffre d’affaires annuel mondial.

Interopérabilité

C’est le critère qu’on sous-estime au moment du choix et qu’on regrette six mois après. Une plateforme construite sur des formats propriétaires fermés transforme chaque nouveau raccordement en projet à part entière. À l’inverse, des standards ouverts, Delta Lake, Apache Parquet, API REST, permettent à vos outils existants de s’y connecter sans friction. Microsoft Fabric illustre cette logique avec OneLake : un même lac de données, accessible par Synapse, Power BI et Azure Databricks sans duplication ni conversion.

Scalabilité et accessibilité

La scalabilité conditionne la pérennité de l’investissement : la plateforme doit pouvoir absorber la croissance des volumes sans refonte majeure. L’accessibilité des interfaces détermine, elle, le niveau d’adoption réelle. Une plateforme irréprochable techniquement mais réservée aux data engineers ne tient pas ses promesses de démocratisation, elle crée simplement un nouveau goulot d’étranglement autour de l’équipe technique.

👉 Remarque

La plupart des incidents de sécurité data ne viennent pas d’attaques externes sophistiquées. Ils résultent de droits d’accès trop larges, accordés par habitude et jamais révoqués. Avant d’investir dans du chiffrement avancé, commencez par vérifier qui a accès à quoi et si c’est vraiment justifié.

Ce qu’une data platform change concrètement

Mettre fin aux vérités multiples

Qu’est-ce que ça m’apporte concrètement ? C’est la question que tout décideur finit par poser et elle mérite une réponse directe.

Dans la plupart des organisations, les données existent. C’est leur cohérence qui fait défaut. La direction financière et la direction commerciale peuvent présenter des chiffres de chiffre d’affaires différents pour le même trimestre, sans que personne ne puisse trancher rapidement. Une source de vérité partagée règle ce problème structurellement et change la nature même des réunions de direction.

Décider plus vite, et mieux

Décider sur des données consolidées et fraîches plutôt que sur des extractions vieilles de trois semaines, c’est réduire le délai entre le signal et l’action. Avec des modèles prédictifs bien alimentés, on anticipe ce qui va se passer plutôt que de commenter ce qui s’est passé.

Libérer du temps sur les bonnes tâches

Pipelines automatisés, transformations récurrentes sans intervention manuelle, rapports distribués sans extraction ad hoc. Le temps libéré se réinvestit dans l’analyse et la décision, pas dans la plomberie des données.

Réduire les coûts, visibles et cachés

La rationalisation des licences redondantes et le modèle cloud pay-as-you-go sont les gains les plus faciles à chiffrer. Mais les coûts indirects sont souvent plus lourds : mauvaises décisions sur données erronées, incidents de sécurité, amendes RGPD. Ce sont eux qu’une data platform bien construite contribue le plus à éviter.

Répondre à la pression réglementaire

Savoir précisément où se trouvent vos données personnelles, qui y accède et comment elles sont protégées est devenu un critère de crédibilité autant qu’une obligation légale. La conformité n’est plus un sujet réservé à la DSI, elle engage la direction.

Ancrer une culture de la donnée

C’est le bénéfice le plus structurant sur le long terme, et le plus difficile à quantifier. Une data platform ne change pas les comportements par magie. Elle crée les conditions pour que les équipes métier s’approprient progressivement les données, cas d’usage après cas d’usage, victoire après victoire.

Les critères essentiels pour bien choisir sa Data Platform

Dans un marché très fourni, six critères permettent de structurer le choix sans s’enliser dans le détail technique.

| Critère | Ce qu’il recouvre | Signal d’alerte | |

|---|---|---|---|

| Couverture fonctionnelle | La plateforme couvre-t-elle l’ensemble du cycle de vie, de l’ingestion à l’analyse ? | Les assemblages successifs de briques semblent complets, mais montrent vite leurs limites hors des cas standards | |

| Compatibilité avec l’existant | Vos principales sources sont-elles prises en charge via des connecteurs fiables ? | Une intégration complexe se traduit directement en surcoûts et délais | |

| Scalabilité | La plateforme peut-elle absorber la croissance sans refonte majeure ? | Des besoins modestes aujourd’hui n’ont aucune raison de le rester | |

| Facilité d’utilisation | Les équipes métier peuvent-elles l’utiliser en autonomie ? | Sans interface accessible, la dépendance à la DSI persiste et la promesse de démocratisation reste lettre morte | |

| Transparence tarifaire | Le modèle de facturation est-il lisible au-delà du périmètre initial ? | Les surprises arrivent rarement à la signature, mais souvent six mois après | |

| Gouvernance et souveraineté | Où sont hébergées vos données ? Qui y accède ? | En Europe, les contraintes réglementaires imposent une vigilance particulière sur la localisation des données | |

Ces critères doivent être évalués ensemble, à l’aune de vos priorités métier. Une bonne Data Platform est avant tout celle qui répond concrètement à vos usages.

Échangez avec notre équipe et bénéficiez d’un accompagnement

Alexis Bourdeau

Directeur de projet